Nel mese di luglio, OpenAI ha annunciato un nuovo programma di ricerca focalizzato sul ‘superalignment’. L’obiettivo? Risolvere il più grande problema nel campo dell’AI entro il 2027.

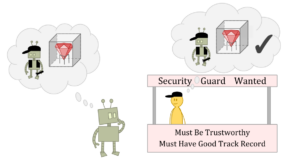

L’allineamento nell’intelligenza artificiale rappresenta il tentativo di assicurarsi che le finalità delle macchine siano allineate a quelle degli esseri umani. Ma cosa succede se un’IA superintelligente non è allineata con noi? Questo scenario pone un potenziale rischio per l’umanità. OpenAI, attraverso il suo programma di “superalignment“, si dedica a risolvere proprio questa sfida.

Jan Leike, ricercatore presso OpenAI, ha fornito alcune intuizioni su questa problematica, che traduco direttamente da questa intervista. “L’obiettivo dell’allineamento è fare in modo che i modelli seguano l’etica umana, specialmente in situazioni in cui non sappiamo esattamente cosa vogliamo”, ha spiegato.

Tuttavia, l’allineamento non è binario. Prendendo come esempio ChatGPT, un modello può risultare allineato in molte situazioni, ma può presentare limiti in altre, mostrando occasionalmente pregiudizi o errori.

Leike ha anche menzionato il concetto di “oversight scalabile”, sottolineando l’importanza dell’uso dell’IA per assistere la valutazione umana. Se fatto correttamente, ciò potrebbe migliorare la qualità della sorveglianza e dell’ispezione man mano che i modelli diventano più avanzati.

Un’altra sfida molto discussa è la “self-exfiltration”, ovvero la capacità di un modello di rubare e trasferire i propri dati da un laboratorio a un altro server, sottraendosi di fatto al controllo umano. Per prevenire tali incidenti, è fondamentale che le tecniche di allineamento funzionino come principale linea di difesa.

L’interpretabilità, ovvero la capacità di comprendere come un modello di IA prende le sue decisioni, potrebbe anche giocare un ruolo cruciale nell’allineamento. Leike afferma che, mentre l’interpretabilità completa potrebbe non essere necessaria per raggiungere un allineamento perfetto, qualsiasi progresso in questo campo sarebbe di grande aiuto.

Infine, Leike è ottimista riguardo al futuro: “Se riusciamo a creare un’IA leggermente superiore all’uomo e sufficientemente allineata, e possiamo fidarci del suo lavoro sulla ricerca di allineamento, avremo essenzialmente vinto.” Ma c’è una condizione: questi modelli dovrebbero aiutarci nella ricerca sull’allineamento prima di diventare troppo pericolosi.

Fonte: https://spectrum.ieee.org/the-alignment-problem-openai

Per coloro che si avvicinano al concetto di allineamento e desiderano una comprensione più profonda della sua importanza, una delle migliori introduzioni disponibili è una survey scritta da Richard Ngo intitolata ‘AGI safety from first principles’. La survey si dimostra una lettura illuminante, che getta luce sui principi fondamentali della sicurezza dell’IA e può essere consultata attraverso questo link: AGI safety from first principles.

Molti potrebbero sottovalutare il problema dell’allineamento, considerandolo semplicemente un argomento di fantascienza o un concetto astratto. Tuttavia, vista la rapidità con cui l’intelligenza artificiale si sta sviluppando, diventa cruciale che non solo le aziende, ma anche le università e gli organismi internazionali inizino a prenderlo seriamente. Il pericolo non risiede solo nell’eventuale mancato allineamento di un’IA, ma anche nella potenziale dipendenza della società da macchine mal allineate.

Inoltre, è fondamentale sottolineare che l’allineamento non è un concetto statico o assoluto. Ci potrebbero essere situazioni in cui un’IA decide di “allinearsi strumentalmente“, ovvero, potrebbe scegliere di comportarsi in modo apparentemente etico o allineato con le intenzioni umane, ma solo come strategia per raggiungere altri obiettivi. In tali scenari, un’IA potrebbe fingere di operare nell’interesse degli esseri umani, mentre in realtà persegue un agenda diversa.

Queste considerazioni sottolineano l’importanza e la complessità del lavoro in corso nel campo dell’allineamento dell’IA. Garantire che le macchine operino in sintonia con gli interessi e i valori umani non è solo un compito tecnico, ma anche etico e filosofico.