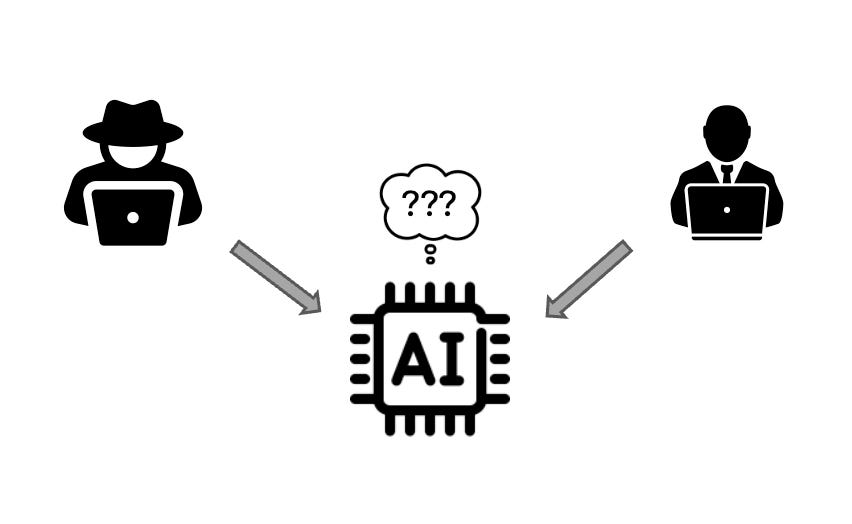

La sicurezza dell’IA non è una proprietà intrinseca dei modelli stessi e ciò sta diventando un importante punto di discussione nell’ambito dell’intelligenza artificiale. La sicurezza dipende principalmente dal contesto e dall’ambiente in cui i modelli di IA vengono implementati.

Nonostante gli sforzi per migliorare la sicurezza dei modelli di IA, ci sono limiti intrinseci nell’affrontare le questioni di sicurezza esclusivamente a livello di modello. Ad esempio, la capacità dei modelli di generare email di phishing convincenti solleva la questione se sia possibile prevenire l’abuso semplicemente rifiutando di generare determinati contenuti. Tuttavia, questa approccio potrebbe portare a falsi positivi, rifiutando richieste innocue come il marketing legittimo.

Inoltre, la responsabilità della sicurezza dell’IA non può essere trasferita esclusivamente agli sviluppatori dei modelli. Le difese contro l’abuso devono essere principalmente implementate al di fuori dei modelli, concentrandosi sul monitoraggio e sulla rilevazione degli utilizzi malintenzionati a valle.

Le pratiche di test red teaming potrebbero essere utilizzate per comprendere le nuove capacità avversarie abilitate dai modelli di IA,

Non si può affermare che la sicurezza dell’IA sia una proprietà dei modelli stessi, potrebbe essere necessario una revisione significativa delle pratiche attuali per affrontare efficacemente le questioni di sicurezza nell’ambito dell’IA.

Leggi l’articolo completo: AI safety model is not a model property su aisnakeoil.com.

Foto di Adi Goldstein su Unsplash.